DeepSeek R1 lokal installieren mit Ollama (2026 Anleitung)

DeepSeek R1 ist ein Reasoning-Modell, das im Januar 2026 vom chinesischen KI-Labor DeepSeek veröffentlicht wurde. Es nutzt Ketten-von-Gedanken-Denken und erzeugt einen sichtbaren Denkprozess, bevor es seine endgültige Antwort liefert. Bei Mathematik-, Coding- und Logik-Benchmarks entspricht R1 OpenAI o1 oder übertrifft es bei einem Bruchteil der Inferenzkosten. Das Modell ist vollständig Open-Weight und kann auf Ihrer eigenen Hardware betrieben werden.

Diese Anleitung behandelt den lokalen Betrieb von DeepSeek R1 mit Ollama. Sie wählen die richtige Modellgröße für Ihre Hardware, laden das Modell, führen Inferenz über die Kommandozeile aus, greifen auf die REST-API zu und verbinden optional eine Web-Oberfläche. Die Anleitung behandelt R1-Varianten von der 1,5B-Parameter-Destillation (läuft auf 4 GB RAM) bis zum vollständigen 70B-Modell (benötigt 48 GB RAM).

Für Nutzer, die DeepSeek R1 auf einem Cloud-Server ohne lokale Hardware betreiben möchten, bietet Contabo Cloud VPS 40 48 GB RAM für €30,25/Monat, was für R1 32B ausreichend ist. Das 70B-Modell benötigt 64+ GB RAM, hierfür reicht Contabo Cloud VPS 50 für €37,00/Monat.

Voraussetzungen

- Linux (Ubuntu 20.04+), macOS 12+ oder Windows 10 mit WSL2

- RAM-Anforderung variiert je nach Modellgröße (Vergleichstabelle in dieser Anleitung)

- 10-60 GB freier Festplattenspeicher je nach Modellvariante

- Ollama 0.6.x oder höher (Installation in dieser Anleitung enthalten)

- (Optional) NVIDIA GPU mit 8+ GB VRAM für hardwarebeschleunigte Inferenz

Diese Anleitung läuft auf einem Standard-VPS.

Contabo Cloud VPS 40 — €30,25/Monat →Inhaltsverzeichnis

Was DeepSeek R1 ist und wie es sich von Standard-LLMs unterscheidet

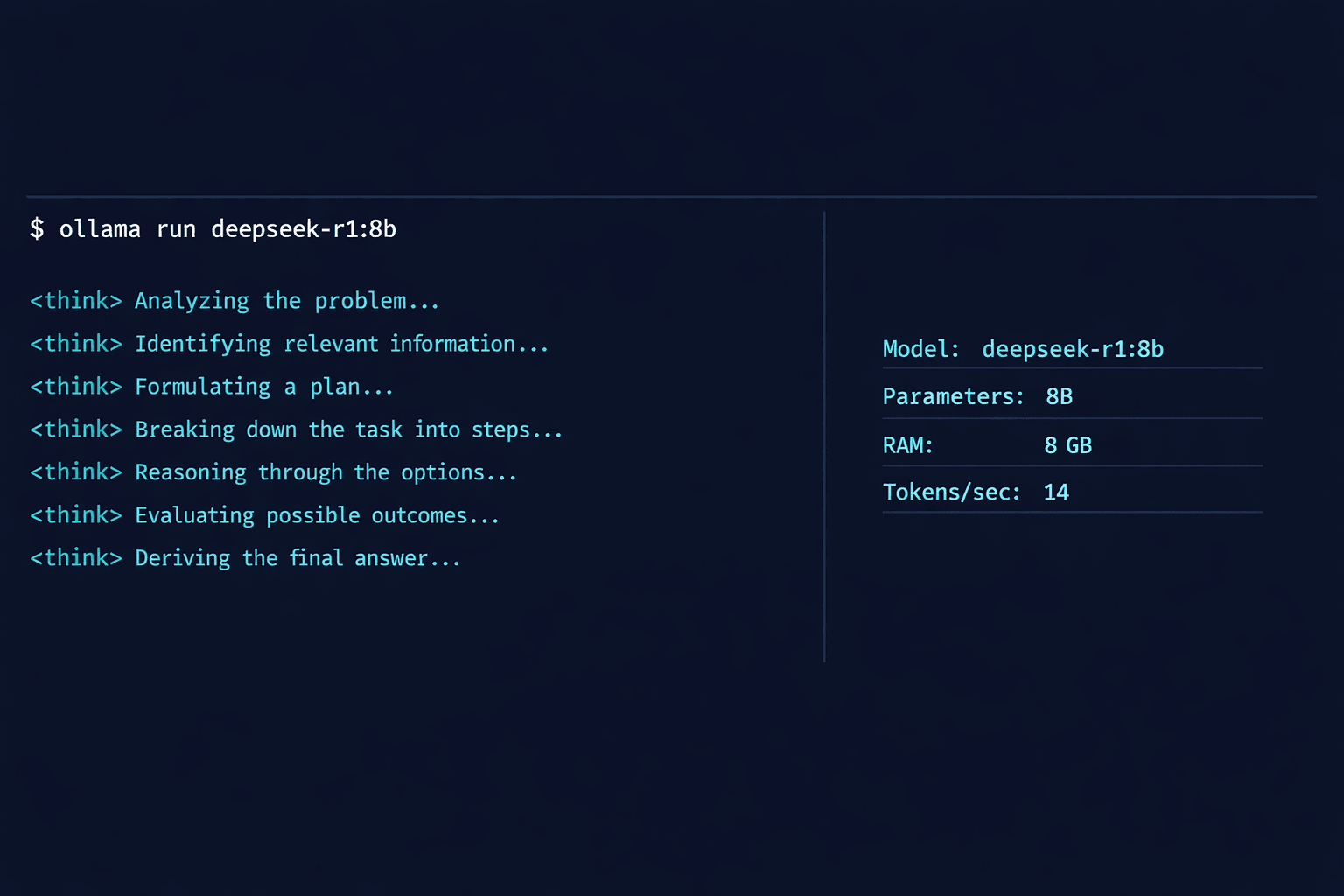

DeepSeek R1 ist ein Reasoning-Modell, kein standardmäßiges autoregressives Sprachmodell. Der Unterschied liegt im Inferenzprozess: R1 generiert eine schrittweise Gedankenkette (in

DeepSeek R1-Varianten auf Ollama (Stand März 2026):

| Modell | Parameter | Architektur | Benötigter RAM | Festplatte | Ideal für |

|---|---|---|---|---|---|

| deepseek-r1:1.5b | 1,5B | Qwen 2.5-Destillat | 2 GB | 1,1 GB | Tests, Low-RAM-Geräte |

| deepseek-r1:7b | 7B | Qwen 2.5-Destillat | 8 GB | 4,7 GB | Allgemein, gute Balance |

| deepseek-r1:8b | 8B | Llama 3-Destillat | 8 GB | 4,9 GB | Coding, Anweisungsfolgen |

| deepseek-r1:14b | 14B | Qwen 2.5-Destillat | 16 GB | 9,0 GB | Besseres Reasoning, 16-GB-RAM |

| deepseek-r1:32b | 32B | Qwen 2.5-Destillat | 32 GB | 20 GB | Hochwertiges Reasoning |

| deepseek-r1:70b | 70B | Llama 3-Destillat | 48 GB | 43 GB | Nahezu volle R1-Qualität |

| deepseek-r1:671b | 671B | MoE (Vollmodell) | 400+ GB | 404 GB | Forschung / Multi-GPU |

Die destillierten Modelle (1,5B bis 70B) sind trainiert, um das Reasoning-Verhalten von R1 in kleineren dichten Architekturen zu reproduzieren.

Ollama installieren

Ollama ist die Laufzeitumgebung, die DeepSeek R1-Modelldateien verwaltet und Inferenz verarbeitet.

Linux und macOS

# Ein-Befehl-Installer

curl -fsSL https://ollama.com/install.sh | shInstallation prüfen:

ollama --version

# Erwartet: ollama version 0.6.xUnter Linux erstellt der Installer einen systemd-Dienst. Status prüfen:

systemctl status ollama

# Erwartet: active (running)Windows (WSL2)

Ubuntu über WSL2 installieren, dann den Linux-Installer im WSL2-Terminal ausführen. Ollama auf Windows hat auch einen nativen Installer unter ollama.com/download.

Docker (für VPS-Deployments)

docker run -d \

-v ollama:/root/.ollama \

-p 11434:11434 \

--name ollama \

ollama/ollamaModellgröße wählen und herunterladen

Das größte Modell wählen, das Ihr RAM unterstützt. Größere Modelle liefern bei komplexen Aufgaben deutlich bessere Reasoning-Ausgaben.

Schnelle Entscheidungshilfe:

- 8 GB RAM:

deepseek-r1:7boderdeepseek-r1:8bverwenden - 16 GB RAM:

deepseek-r1:14bverwenden - 32 GB RAM:

deepseek-r1:32bverwenden - 48 GB RAM:

deepseek-r1:70bverwenden

Verfügbaren RAM vor dem Herunterladen prüfen:

# Linux

free -h

# macOS

vm_stat | grep "Pages free"Modell herunterladen (Beispiel: 14B-Variante):

ollama pull deepseek-r1:14b

# Erwartete Ausgabe:

# pulling manifest

# pulling 6e9f90f02bb3... 100% ████████ 9.0 GB / 9.0 GB

# successDer Download des 14B-Modells (9 GB) dauert bei einer 150-Mbps-Verbindung ca. 8 Minuten.

Verfügbarkeit des Modells bestätigen:

ollama list

# Erwartete Ausgabe:

# NAME ID SIZE MODIFIED

# deepseek-r1:14b ea35dfe18182 9.0 GB vor 2 MinutenErste Inferenz ausführen

Interaktive CLI-Sitzung

Eine interaktive Sitzung direkt im Terminal starten:

ollama run deepseek-r1:14bNach dem Laden des Modells (10-20 Sekunden beim ersten Start) einen Prompt eingeben:

>>> Lösen Sie dies schrittweise: Ein Zug fährt 120 km mit 60 km/h, dann 80 km mit 40 km/h. Was ist die Durchschnittsgeschwindigkeit für die gesamte Reise?DeepSeek R1 generiert einen sichtbaren Reasoning-Block vor der endgültigen Antwort:

<think>

Um die Durchschnittsgeschwindigkeit zu berechnen, benötige ich die Gesamtstrecke geteilt durch die Gesamtzeit.

Gesamtstrecke = 120 km + 80 km = 200 km

Zeit für das erste Teilstück = 120 km / 60 km/h = 2 Stunden

Zeit für das zweite Teilstück = 80 km / 40 km/h = 2 Stunden

Gesamtzeit = 4 Stunden

Durchschnittsgeschwindigkeit = 200 km / 4 Stunden = 50 km/h

</think>

Die Durchschnittsgeschwindigkeit für die gesamte Reise beträgt 50 km/h.Der -Tag ist die endgültige Antwort.

Einzelne Inferenz (nicht-interaktiv)

ollama run deepseek-r1:14b "Was ist die Zeitkomplexität von Merge Sort und warum?"Inferenzgeschwindigkeit prüfen

Nach einem Prompt gibt Ollama Performance-Statistiken aus:

eval count: 312 token(s)

eval duration: 22.4s

eval rate: 13.9 tokens/sBei reiner CPU-Inferenz mit dem 14B-Modell: 8-15 Token/Sekunde auf einem 4-Kern-VPS. Mit NVIDIA-GPU: 40-120 Token/Sekunde.

Ollama REST-API verwenden

Ollama stellt eine REST-API unter http://localhost:11434 und einen OpenAI-kompatiblen Endpunkt unter http://localhost:11434/v1 bereit.

Native Ollama-API

curl http://localhost:11434/api/generate \

-H "Content-Type: application/json" \

-d '{

"model": "deepseek-r1:14b",

"prompt": "Erkläre wie Quicksort in drei Sätzen funktioniert.",

"stream": false

}'Die JSON-Antwort enthält den Reasoning-Trace im Feld response:

{

"model": "deepseek-r1:14b",

"response": "<think>\nQuicksort funktioniert...\n</think>\n\nQuicksort ist ein Teile-und-herrsche-Algorithmus...",

"done": true,

"eval_count": 198,

"eval_duration": 14200000000

}Think-Block aus API-Antworten entfernen

Falls die Anwendung nur die endgültige Antwort benötigt, den Think-Block mit Python herausfiltern:

import re

def think_entfernen(response: str) -> str:

"""DeepSeek R1 <think>...</think>-Block aus der Antwort entfernen."""

return re.sub(r'<think>.*?</think>', '', response, flags=re.DOTALL).strip()

# Verwendungsbeispiel

roh = "<think>\nLet me work through this...\n</think>\n\nDie Antwort ist 42."

sauber = think_entfernen(roh)

print(sauber)

# Ausgabe: Die Antwort ist 42.Open-WebUI als Chat-Oberfläche verbinden

Open-WebUI gibt DeepSeek R1 eine ChatGPT-ähnliche Browser-Oberfläche, einschließlich der Unterstützung für das Rendern der

Schnellstart mit Docker

docker run -d \

-p 3000:8080 \

-e OLLAMA_BASE_URL=http://host.docker.internal:11434 \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:mainhost.docker.internal durch die Docker-Bridge-IP ersetzen (typischerweise 172.17.0.1). Ermitteln mit: ip route | grep docker0http://localhost:3000 im Browser öffnen. deepseek-r1:14b aus der Modell-Dropdown-Liste auswählen. Open-WebUI rendert den

Eine ausführliche Anleitung zur Open-WebUI-Einrichtung finden Sie in der Open-WebUI-Anleitung.

GPU-Beschleunigung aktivieren

GPU-Inferenz reduziert die Antwortzeit von 10-15 Token/Sekunde (CPU) auf 40-120 Token/Sekunde (GPU).

NVIDIA-GPU (CUDA)

Ollama erkennt NVIDIA-GPUs automatisch unter Linux, wenn das NVIDIA CUDA Toolkit installiert ist:

ollama run deepseek-r1:14b "Hallo"

# GPU-Nutzung in einem zweiten Terminal prüfen:

nvidia-smiFalls die GPU nicht erkannt wird, CUDA-Toolkit installieren:

# Ubuntu 22.04

sudo apt install nvidia-cuda-toolkitPartial GPU Offloading (Gemischt CPU + GPU)

Falls das Modell nicht vollständig in den VRAM passt, lagert Ollama so viele Schichten wie möglich auf die GPU aus. Dies geschieht automatisch.

journalctl -u ollama -f | grep "offload"

# Beispielausgabe:

# llm_load_tensors: offloading 28 repeating layers to GPU

# llm_load_tensors: offloaded 28/41 layers to GPUApple Silicon (Metal)

Auf Apple Silicon Macs verwendet Ollama automatisch das Metal-GPU-Framework. Keine Konfiguration erforderlich. Der M2 Pro mit 16 GB Unified Memory führt deepseek-r1:14b mit ca. 20-30 Token/Sekunde aus.

Fehlerbehebung

| Problem | Ursache | Lösung |

|---|---|---|

| Modell-Download bricht mit "context deadline exceeded" ab | Netzwerk-Timeout beim großen Modell-Download. Häufig bei 14B+-Modellen über langsame oder instabile Verbindungen. | ollama pull deepseek-r1:14b erneut ausführen. Ollama setzt unvollständige Downloads fort und beginnt nicht von vorne. |

| Inferenz extrem langsam (unter 3 Token/Sekunde) | Das Modell passt nicht in den RAM. Das System verwendet Swap-Speicher für die Inferenz. | RAM-Nutzung prüfen: free -h. Bei aktivem Swap auf eine kleinere Modellvariante wechseln. deepseek-r1:7b benötigt 8 GB RAM, deepseek-r1:1.5b nur 2 GB. |

| CUDA out of memory beim Laden des Modells | GPU-VRAM ist für die gewählte Modellgröße unzureichend. | Flash Attention aktivieren: OLLAMA_FLASH_ATTENTION=1 setzen. Bei anhaltendem Fehler auf ein kleineres Modell wechseln. Ollama macht automatisch Partial GPU Offloading. |

| Der <think>-Block ist sehr lang (1000+ Token) vor der Antwort | R1 "überlegt" zu viel bei einfachen Prompts und exploriert mehrere Pfade selbst bei trivialen Fragen. | "Antworten Sie direkt." oder "Seien Sie präzise." zum Prompt hinzufügen. Dies reduziert die Länge des Think-Blocks erheblich. |

| API gibt 404 zurück bei `http://localhost:11434/v1/chat/completions` | Ollama-Version ist älter als 0.1.24. Der OpenAI-kompatible Endpunkt wurde erst in dieser Version hinzugefügt. | Ollama aktualisieren: curl -fsSL https://ollama.com/install.sh | sh. Version prüfen: ollama --version. |

| Modell lädt beim ersten Start, aber folgende Starts beginnen von vorne | OLLAMA_KEEP_ALIVE ist zu niedrig gesetzt, das Modell wird zwischen Anfragen entladen. | Keep-Alive erhöhen: OLLAMA_KEEP_ALIVE=30m oder -1 setzen, um das Modell dauerhaft geladen zu halten. systemd-Override-Datei bearbeiten und Dienst neu starten. |

Alternativen

| Tool | Art | Preis | Ideal für |

|---|---|---|---|

| LM Studio | Desktop-App | Kostenlos | Windows- und macOS-Nutzer, die eine GUI statt CLI bevorzugen. Unterstützt DeepSeek R1 GGUF-Modelle direkt. |

| Jan | Desktop-App | Kostenlos / Open-Source | Eine datenschutzorientierte Electron-App für lokale Modelle. Unterstützt DeepSeek R1 über GGUF. Gut für den persönlichen Desktop-Einsatz. |

| llama.cpp (direkt) | CLI | Kostenlos / Open-Source | Maximale Kontrolle und Performance-Optimierung. Ollama verwendet llama.cpp intern. Für Entwickler, die benutzerdefinierte Quantisierung oder Build-Optionen benötigen. |

| Together AI (DeepSeek R1 API) | Cloud | $0,18 pro 1M Token (Eingabe) | Ausführen von R1 70B oder dem vollständigen 671B-Modell ohne lokale Hardware. Kosteneffektiv für geringes Nutzungsvolumen. |

Häufige Fragen

Was ist der minimale RAM für den lokalen Betrieb von DeepSeek R1?

Die kleinste DeepSeek R1-Variante, deepseek-r1:1.5b, benötigt ca. 2 GB RAM. Sie ist eine 1,5-Milliarden-Parameter-Destillation des vollständigen R1-Modells, trainiert auf Qwen 2.5. Die Reasoning-Qualität ist merklich niedriger als bei den größeren Varianten, läuft aber auf fast jedem Rechner.

Für den praktischen täglichen Einsatz sind die 7B- oder 8B-Varianten das empfohlene Minimum mit 8 GB RAM und deutlich besserem Reasoning als Standard-LLMs ähnlicher Größe.

Ist DeepSeek R1 sicher lokal zu betreiben? Gibt es Datenschutzbedenken?

Den lokalen Betrieb von DeepSeek R1 über Ollama zu nutzen bedeutet, dass alle Inferenz auf Ihrer Hardware stattfindet. Keine Prompts, Antworten oder Daten verlassen Ihren Rechner.

Die Datenschutzbedenken bezüglich DeepSeek betreffen deren Cloud-API und Web-Oberfläche (chat.deepseek.com), die dem chinesischen Datenschutzrecht und DeepSeeks Datenschutzrichtlinie unterliegen. Wenn Sie das Open-Weight-Modell lokal über Ollama ausführen, nutzen Sie nur die Modellgewichte ohne Verbindung zu DeepSeeks Servern.

Wie schneidet DeepSeek R1 im Vergleich zu GPT-4o bei Coding-Aufgaben ab?

Bei Standard-Coding-Benchmarks (HumanEval, SWE-Bench) sind DeepSeek R1-Destillationen wettbewerbsfähig mit GPT-4o, und die 70B-Variante übertrifft GPT-4o bei mehreren Benchmarks. Die Reasoning-Kette ist besonders nützlich beim Debugging und Algorithmusdesign.

Der Vorteil von R1 ist am deutlichsten bei Aufgaben mit mehrstufigem Reasoning: Algorithmus-Optimierung, Debugging von Logikfehlern und mathematische Problemlösung. Für einfache Code-Vervollständigungen sind Standardmodelle wie Llama 3.3 8B schneller.

Welche DeepSeek R1-Variante eignet sich für einen Rechner mit 16 GB RAM?

deepseek-r1:14b verwenden. Mit 9 GB Modellgröße bleiben ca. 7 GB für Betriebssystem und andere Prozesse auf einem 16-GB-Rechner. Dies ist der Sweet Spot für 16 GB RAM: die 8B-Modelle lassen zu viel RAM ungenutzt, während das 32B-Modell 32 GB benötigt und auf 16 GB zu starkem Swap führt.

Die 14B-Variante ist eine Qwen 2.5-Destillation und liefert konsistent gutes Reasoning. Auf CPU läuft sie mit ca. 10-15 Token/Sekunde, mit einer Mittelklasse-NVIDIA-GPU mit 30-50 Token/Sekunde.

Funktioniert DeepSeek R1 offline nach dem Download?

Ja. Nach dem Herunterladen mit ollama pull deepseek-r1:14b läuft die gesamte Inferenz lokal ohne Internetverbindung. Ollama sendet während der Inferenz keine Daten, und die Modellgewichte werden in ~/.ollama/models gespeichert.

Die einzigen Netzwerkanforderungen sind der initiale Download (9 GB für das 14B-Modell) und zukünftige Modell-Updates.

Was kostet der Betrieb von DeepSeek R1 auf einem Cloud-VPS im Vergleich zur DeepSeek-API?

DeepSeeks eigene API berechnet $0,55 pro Million Input-Token für R1. Bei 500 Token pro Anfrage sind das $0,000275 pro Anfrage. Für 1.000 Anfragen pro Monat: $0,28.

Der Break-Even-Punkt hängt vom Nutzungsvolumen ab. Ein Contabo Cloud VPS 40 für €30,25/Monat betreibt deepseek-r1:32b rund um die Uhr. Bei mehr als 110.000 Anfragen pro Monat wird der VPS günstiger als die API. Für den persönlichen Einsatz ist die API wirtschaftlicher; für Unternehmen mit Batch-Verarbeitung gewinnt der VPS mit Festkosten.

Kann DeepSeek R1 als Backend für n8n oder andere Automatisierungs-Tools verwendet werden?

Ja. Ollama stellt einen OpenAI-kompatiblen API-Endpunkt unter http://localhost:11434/v1 bereit, den n8n's KI-Knoten als benutzerdefinierte OpenAI-Basis-URL akzeptiert. Die Basis-URL auf Ihren Ollama-Endpunkt setzen, API-Schlüssel auf eine beliebige nicht-leere Zeichenkette setzen und deepseek-r1:14b als Modell auswählen.

Der

Server für dieses Projekt

Contabo (gegründet 2003 in München) bietet VPS mit unbegrenztem Traffic, vollem Root-Zugriff und Rechenzentren in Deutschland, USA, Singapur und weiteren Regionen.

Contabo Cloud VPS 40 — €30,25/Monat ansehen →Affiliate-Link. Provision bei Kauf, ohne Mehrkosten für dich.

Verfasst von

AmaraKI-Expertin bei KI Tool Entdeckung. Spezialisiert auf Self-Hosting, lokale KI-Modelle und KI-Automatisierung. Zuletzt aktualisiert: 7. April 2026